Fairness y Seguridad en CAT: Control de Exposición, Sesgos (DIF) y Cumplimiento

El sesgo en pruebas aparece cuando un ítem introduce barreras ajenas a la competencia que se busca medir, generando diferencias que no se explican por el desempeño real. En selección de talento, esto compromete la equidad, por lo que la EEOC recomienda validar los instrumentos y revisar alternativas con menor impacto adverso.

A la vez, la seguridad de ítems y el control de exposición son esenciales para proteger la validez de la evaluación. ETS señala que rotar contenido, detectar filtraciones y monitorear patrones anómalos reduce la memorización y ayuda a que los resultados reflejen habilidades reales, no ventajas por familiaridad previa. Si quieres aprender más sobre este tema, te recomendamos leer Las Pruebas de Integridad son Clave en la Selección de Personal.

En este artículo, veremos cómo el análisis del sesgo y el control de exposición fortalecen procesos de selección más justos y confiables.

Si buscas aplicarlo en tu organización, agenda un demo con Evaluar.

Tabla de contenidos:

-

La Importancia del Control de Exposición en Pruebas

-

Entendiendo el Sesgo (DIF) en Evaluaciones

-

Estrategias para Garantizar la Fairness en las Evaluaciones

-

Cumplimiento Normativo en las Pruebas de Evaluación

-

Errores Comunes en la Evaluación de Talento

- Conclusión

La Importancia del Control de Exposición en Pruebas

En las pruebas adaptativas computarizadas (CAT), el control de exposición regula cuántas veces aparece cada ítem y bajo qué reglas se administra a los candidatos. Esta práctica es decisiva porque, cuando un grupo reducido de preguntas se muestra con demasiada frecuencia, aumenta el riesgo de memorización, filtración y pérdida de validez. ETS identifica el control de exposición como un componente central para proteger la seguridad de los ítems y sostener la calidad de la medición. Además, sus estándares de calidad y equidad indican que, en pruebas adaptativas, deben documentarse las reglas de selección de ítems y de control de exposición, junto con su justificación técnica. Para ampliar esta perspectiva, consulta Errores Comunes en la Evaluación de Talento.

Implementar un sistema sólido de control de exposición también favorece evaluaciones más consistentes y justas, ya que reduce ventajas derivadas de la familiaridad previa con ciertos reactivos y refuerza procesos más defendibles desde el punto de vista técnico.

Entendiendo el Sesgo (DIF) en Evaluaciones

El DIF (Differential Item Functioning) aparece cuando personas de distintos grupos, pero con un nivel comparable de conocimiento o habilidad, tienen probabilidades diferentes de responder correctamente un mismo ítem. ETS explica que este análisis se utiliza como una verificación empírica de la equidad, porque ayuda a identificar preguntas que podrían estar introduciendo desventajas ajenas a la competencia evaluada. Al mismo tiempo, el DIF no prueba por sí solo que exista sesgo: funciona como una alerta técnica que debe revisarse junto con el contenido, el lenguaje, el contexto y la finalidad de la prueba. Puedes ampliar este tema en nuestro artículo Sesgos en la Selección de Talento: Desafíos y Soluciones.

Por eso, identificar y mitigar el DIF es clave para fortalecer la validez y la justicia de las evaluaciones. ETS también señala que, cuando hay datos suficientes, conviene investigar DIF por grupos relevantes y revisar o retirar ítems con resultados elevados antes de su uso operativo.

Estrategias para Garantizar la Fairness en las Evaluaciones

Para garantizar la fairness en las evaluaciones, no basta con observar el resultado final; también es necesario revisar cómo se diseñan los ítems, cómo responden distintos grupos y qué tan alineados están los puntajes con la competencia que realmente se desea medir. ETS señala que una evaluación justa combina lineamientos de redacción y revisión de contenido con evidencia empírica, como estudios de DIF, para reducir la varianza ajena al constructo y fortalecer la validez de la interpretación de los resultados. También puedes leer más acerca de cómo las pruebas psicométricas ayudan en la selección de personal en Pruebas Psicométricas: Guía Completa de Tipos, Beneficios y Mejores Prácticas.

En selección de talento, la EEOC añade que las pruebas deben validarse para el cargo y propósito específicos y, si generan impacto adverso, conviene evaluar alternativas igual de efectivas con menor efecto excluyente. Por eso, más que depender de una sola herramienta, la clave está en un proceso técnico continuo: análisis estadístico, revisión experta y monitoreo periódico.

Cumplimiento Normativo en las Pruebas de Evaluación

Cumplir con las normativas y estándares en evaluación no es solo una buena práctica: es lo que permite que una prueba sea técnicamente sólida, justa y defendible ante auditorías o revisiones. Los Standards for Educational and Psychological Testing, desarrollados por AERA, APA y NCME, señalan que la fairness es un tema central de validez y que las interpretaciones de puntaje deben sostenerse también para los subgrupos relevantes. En selección, la EEOC añade que una prueba no debe excluir de forma desproporcionada a un grupo protegido, salvo que sea job-related y consistente con la necesidad del negocio, con evidencia de validación adecuada.

Desde esta perspectiva, el cumplimiento normativo implica documentar propósito, relación con el puesto, criterios de puntuación, evidencia de validez, seguridad y revisiones periódicas. SIOP resume estos mínimos en cinco criterios: resultados justos, contenido vinculado al trabajo, capacidad predictiva, consistencia y documentación para verificación y auditoría.

Errores Comunes en la Evaluación de Talento

Al evaluar talento, es frecuente cometer errores que afectan la validez, la equidad y la correcta interpretación de los resultados. Los Standards for Educational and Psychological Testing indican que quienes usan pruebas deben conocer la evidencia de validez, proteger la seguridad del contenido y contar con la preparación necesaria para administrar e interpretar puntuaciones de forma responsable.

- No realizar análisis de sesgo: Omitir estudios de DIF dificulta detectar ítems que funcionen de manera distinta entre grupos comparables. ETS recomienda este análisis como una verificación empírica de fairness. Revise nuestro artículo sobre Errores Comunes en la Evaluación de Talento.

- Sobreexposición de ítems: Repetir demasiado ciertas preguntas deteriora la seguridad del banco y puede comprometer la comparabilidad de la prueba. En evaluaciones adaptativas, los estándares exigen documentar reglas de selección y control de exposición.

- Falta de formación: La administración e interpretación de pruebas debe recaer en personas con capacitación, credenciales o experiencia suficientes.

Evitar estos errores fortalece decisiones más precisas y justas.

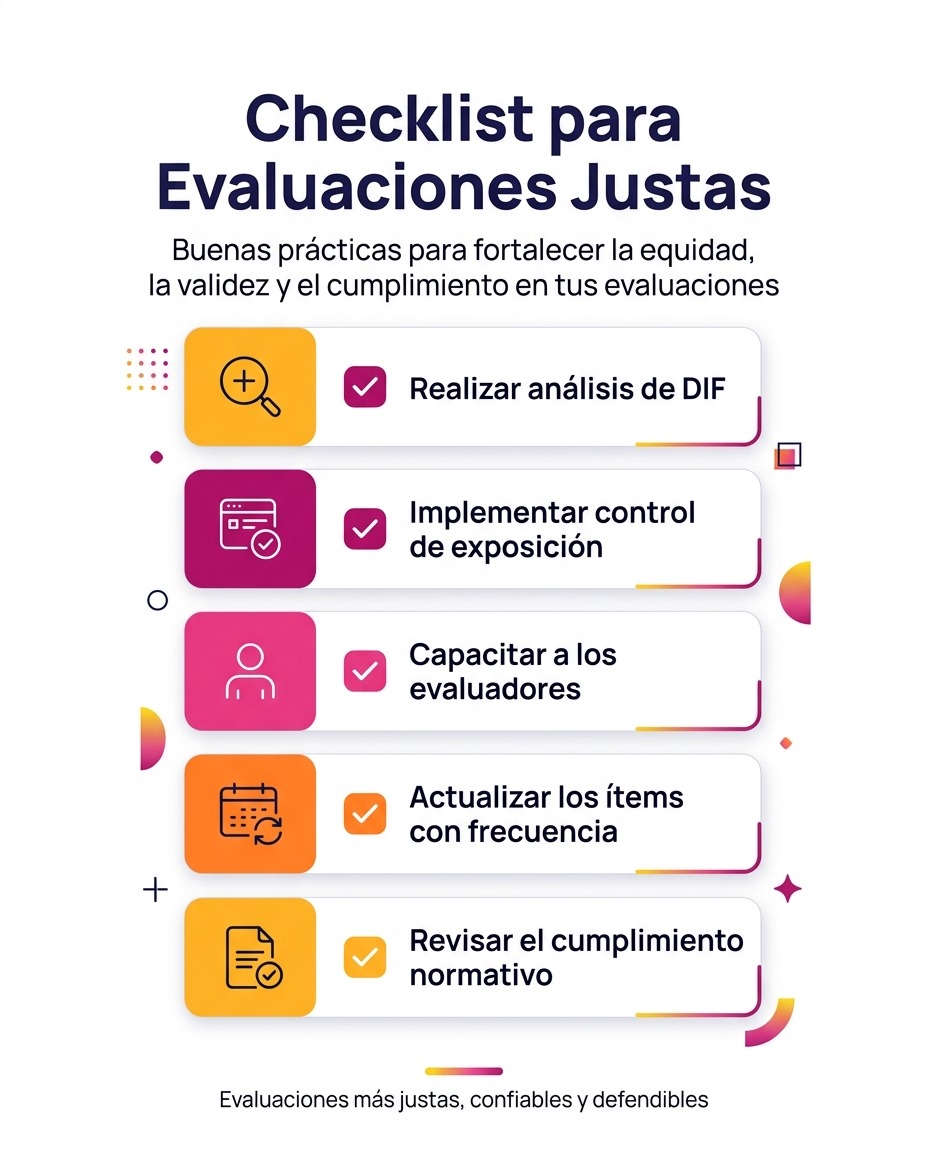

Checklist para Evaluaciones Justas

Para garantizar evaluaciones justas y efectivas, conviene seguir una checklist alineada con estándares internacionales. AERA, APA y NCME indican que la equidad depende tanto de la validez de las interpretaciones como de la seguridad del contenido y de la capacitación de quienes usan la prueba. En selección, la EEOC añade que, si un procedimiento genera impacto adverso, debe analizarse y sostenerse con evidencia de validez.

- Realizar análisis de DIF regularmente para identificar ítems que funcionen de forma distinta entre grupos comparables.

- Implementar un control de exposición efectivo, especialmente en pruebas adaptativas, para proteger la comparabilidad y la seguridad de los ítems.

- Capacitar a los evaluadores y asignar la interpretación solo a personal con formación y experiencia suficientes.

- Actualizar frecuentemente los ítems y retirar contenido comprometido o reutilizado en exceso para preservar su integridad.

- Revisar el cumplimiento normativo del proceso completo, incluyendo impacto adverso y evidencia de validez.

Conclusiones

La fairness y la seguridad de ítems no son elementos secundarios en una evaluación: son condiciones necesarias para que los resultados sean válidos, comparables y útiles en la toma de decisiones de selección. Los Standards for Educational and Psychological Testing establecen que la equidad forma parte de la validez de las interpretaciones, mientras que ETS subraya que la calidad de una prueba depende de que sea técnicamente sólida, justa, confiable y protegida frente a riesgos de integridad.

En ese marco, controlar la exposición de los reactivos, revisar periódicamente el banco de ítems y aplicar análisis de DIF permite reducir ventajas indebidas, detectar posibles fuentes de sesgo y sostener procesos más transparentes. El manual técnico de Praxis explica que el DIF sirve para medir la fairness de los ítems a nivel de subgrupos y apoyar decisiones sobre revisión o retiro de preguntas problemáticas.

Fuentes

- U.S. Equal Employment Opportunity Commission (EEOC) — Employment Tests and Selection Procedures

- Testing Standards — Standards for Educational and Psychological Testing

- ETS — ETS Standards for Quality and Fairness

- ETS — ETS Guidelines for Developing Fair Tests and Communications

- ETS Praxis — A DIF Primer

- ETS Praxis — Technical Manual for the Praxis® Tests and Related Assessments

También te puede interesar

-

Costos y ROI de Implementar IA en Recursos Humanos

- Cómo optimizar la selección de personal con el algoritmo CAT (Test Adaptativo Computarizado)